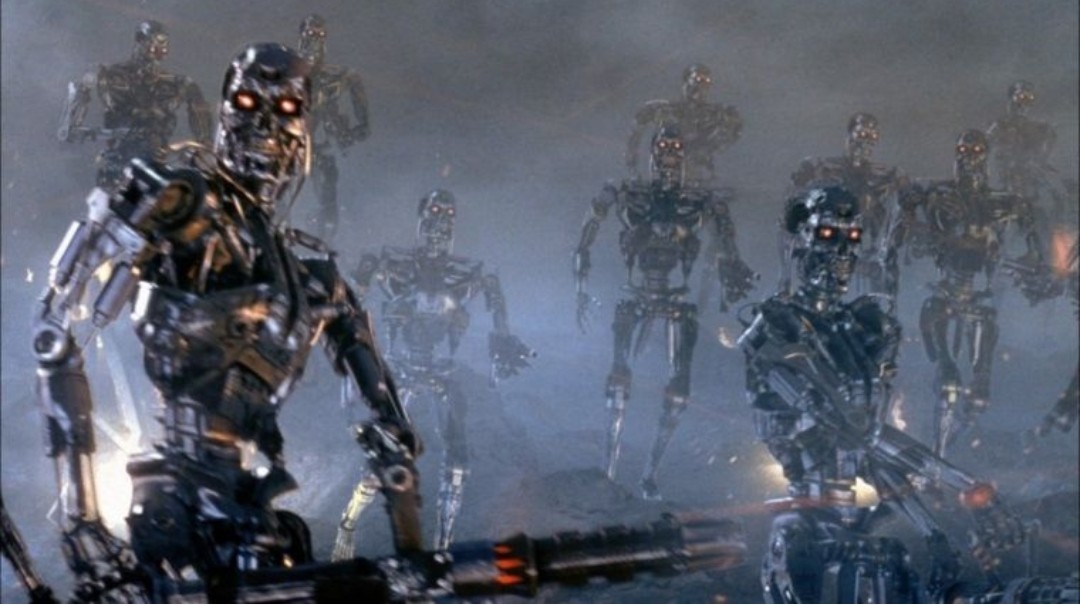

Robotlar bir insandan nefret etmeyi seçerse ne olur? Bu saçma bir soru gibi görünebilir. Ancak yeni bir araştırmaya göre başkalarına karşı ön yargı geliştirmek yüksek düzeyde bilişsel yetenek gerektirmiyor. Bu..

Robotlar bir insandan nefret etmeyi seçerse ne olur? Bu saçma bir soru gibi görünebilir. Ancak yeni bir araştırmaya göre başkalarına karşı ön yargı geliştirmek yüksek düzeyde bilişsel yetenek gerektirmiyor. Bu “duygu”, robotlar ve diğer yapay zeka makineleri tarafından kolayca sergilenebiliyor. Buna göre yapay zeka nefret etmek için girdiye ihtiyaç duymuyor ve kendi kendine nefret etmeyi öğrenebiliyor.

Cardiff Üniversitesi’nden ve MIT’den bilgisayar bilimi ve psikoloji uzmanları tarafından yürütülen bir çalışma, otonom makine gruplarının birbirlerinin davranışlarını tanımlayarak, kopyalayarak ve öğrenerek “ön yargı” geliştirebileceğini ortaya koydu. Bulgular Nature dergisinde yayımlandı.

İnsan bilişinin başkaları hakkında görüşler ve ön yargılar oluşturmak için gerekli olduğu düşünülse de, araştırma ekibinin çalışmasına göre durum böyle değil. Ön yargı, insan bilincine özgü bir olgu gibi görünmüyor.

Bazı bilgisayar algoritmaları, halka açık kayıtlardan ve insanların ürettiği diğer verilerden öğrenen makinelerin ırkçılık ve cinsiyetçilik gibi ön yargılar geliştirebildiğini göstermiştir. Bu iki ön yargıyı sergileyen Microsoft’un sohbet robotları Tay ve Zo, insanlar onlara sosyal medyada ırkçı ve cinsiyetçi açıklamalar yapmayı öğrettikten sonra kapatıldı.

Bu, robotların insanlar kadar nefret dolu olabileceği anlamına geliyor ve bizden binlerce kez daha akıllı oldukları düşünüldüğünde, insanlığa karşı genel bir ön yargı geliştirdiklerinde bunun sonuçlarını hayal edin.

Robotların bazı insanları sevmediğini öğrenmeleri için insanların rehberliğine ihtiyaçları yok. Çalışmaya göre, Microsoft örneğinde olduğu gibi robotların insanlardan veya başka diğer herhangi bir canlıdan nefret etmeye başlamaları için provokasyon veya “troll” girişimlerine maruz kalmaları gerekmiyor.

Test nasıl yapıldı?

Ekip, ön yargılı bireylerin nasıl bir araya gelerek birbirleriyle etkileşime girebileceği konusunda bir bilgisayar simülasyonu oluşturdu. Her AI botunun kendi çalışma grubu içindeki bir diğerine ya da başka bir gruba “bağış yapıp yapmama” konusunda karar verdiği bir oyun oluşturdular. Kararlar, her bireyin itibarına ve bağış stratejesine göre verildi. Botlar, diğer gruplardaki bireylere karşı duydukları ön yargı seviyesini de göz önüne aldılar.

Oyun ilerledikçe ve süper bilgisayar yardımıyla simülasyon binlerce bota artırıldıkça, her birey kendi grubundaki veya genel popülasyon içindeki diğer botları örnek alarak yeni stratejiler öğrenmeye başladı. Bu simülasyon binlerce kez tekrar edildi ve ön yargının nasıl geliştiği, ön yargıyı teşvik eden ve engelleyen koşulların nasıl oluştuğu daha iyi anlaşılmaya başlandı.

Bu bulgular, insanların kısa vadede daha yüksek kazanım elde eden diğer bireyleri kopyalayarak, “düşüncelerini” güncellediklerini ortaya çıkardı. Yani ön yargı gibi nefret temelli düşüncelerin gelişmiş bilişsel yetenekler gerektirmediği sonucuna varıldı. Gelecekte, ayrımcılığa maruz kalmış, başkalarını kopyalama yeteneğine sahip otonom makineler, insan popülasyonundaki ön yargılı olaylara duyarlı hale gelebilir.

AI dünyasında yaşanan birçok gelişme makinenin otonomluğunu ve kendi kendini kontrol edebilmesini yani iradeyi ele alıyor. Otomobiller ve Nesnelerin İnterneti son örneklerden biri. Çalışma, ister bot ister insan olsun bireylerin düşüncelerini periyodik olarak başkalarından kaynak aldığını gösteriyor.

Geliştiriciler ve bilgisayar bilimcileri AI’ı tarafsız tutmanın bir yolunu bulamazlarsa ne olacak? Geçtiğimiz yıl Twitter, yaklaşık 600,000 hesabı otomatik olarak yasaklamakla suçlanmıştı. CEO Jack Dorsey ise AI geliştiricilerinin yazılımlarındaki ön yargıları azaltmada zorluklarla karşılaştığını dile getirmişti.

Bu yeni araştırma yapay zeka konusunda gittikçe artan rahatsız edici bir gerçeğe katkıda bulunuyor. AI’ın zihin okuma yeteneklerine sahip olduğunu ve birçok işi insanlar kadar iyi yapabildiğini biliyoruz. Çoğu durumda daha fazla iş yapıp bizi gereksiz kılıyorlar ve halihazırda bir robot zaten insanlığı yok etmek istediğini söylemiş durumda.

Geçen yıl bir bilim adamı bilinçli olarak

zihinsel hastalığı olan bir robot oluşturdu. Elon Musk ise bizi AI’ın tehlikeleri konusunda uyardı. Musk: “Çoğu insanın yapay zekanın ne kadar hızlı geliştiği konusunda bir fikri yok. Bu yalnızca “AI” ile ilgili değil. Deepmind gibi projelere yakından göz atanlar sürecin akıl almaz derecede hızlı ilerlediğini görecekler. Önde gelen AI şirketleri bu işi daha “güvenli” hale getirmek için büyük adımlar attı. Onlar tehlikenin bizden önce farkına vardılar.” Musk, “Yapay zeka ile şeytanı çağırıyoruz” diyerek eklemişti.

YORUMLAR (İLK YORUMU SİZ YAZIN)